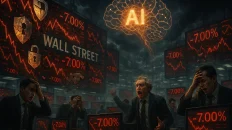

Sam Altman acaba de decirle a sus propios empleados que no tienen voz ni voto sobre cómo el Pentágono usa ChatGPT. En una reunión interna filtrada a CNBC, el CEO de OpenAI dejó caer una bomba: “Quizás pienses que el ataque a Irán estuvo bien y la invasión a Venezuela estuvo mal. No te toca opinar.”

Esto no es ciencia ficción. Esto está pasando ahora.

El contexto que nadie quiere ver

La reunión ocurrió apenas cuatro días después de que OpenAI anunciara su nuevo acuerdo con el Departamento de Defensa de Estados Unidos. Horas después de ese anuncio, Estados Unidos e Israel comenzaron a bombardear Irán.

No es coincidencia. Es estrategia.

Según la transcripción revisada por CNBC, Altman explicó que el Pentágono “respeta la experiencia técnica de OpenAI” y quiere su opinión sobre dónde encajan sus modelos. Pero —y aquí viene lo importante— las decisiones operacionales quedan en manos del Secretario Pete Hegseth.

La traición a Anthropic

Lo que hace esto aún más turbio es el timing. OpenAI cerró su trato con el Pentágono justo después de que Anthropic fuera puesta en lista negra y etiquetada como “Riesgo para la Cadena de Suministro de Seguridad Nacional”.

¿Por qué Anthropic cayó en desgracia? Por negarse a aceptar que sus modelos se usaran para armas autónomas o vigilancia masiva de ciudadanos americanos. Querían garantías. El Pentágono quería carta blanca.

Anthropic dijo que no. OpenAI dijo que sí.

Incluso Trump ordenó a todas las agencias federales “cesar inmediatamente” el uso de tecnología de Anthropic. La ironía: Claude, el modelo de Anthropic, fue usado en los ataques a Irán y en la captura del expresidente venezolano Nicolás Maduro en enero.

La carrera armamentista de la IA

Altman no está solo en esto. xAI de Elon Musk también firmó para desplegar sus modelos en sistemas clasificados. Y según Altman, la diferencia es clara:

“Creo que tendremos los mejores modelos, lo que animará al gobierno a trabajar con nosotros incluso si nuestra stack de seguridad les molesta. Pero habrá al menos otro actor, que asumo será xAI, que efectivamente dirá: Haremos lo que quieran.”

Es una admisión brutal. Altman reconoce que hay una carrera hacia el fondo, donde las empresas compiten por quién pone menos restricciones éticas.

¿Qué significa esto para ti?

Cada vez que usas ChatGPT, estás alimentando el mismo sistema que ahora opera en redes clasificadas del Pentágono. La misma tecnología que te ayuda a redactar emails está siendo entrenada para operaciones militares.

OpenAI ya no es una startup idealista. Es un contratista de defensa con $200 millones del Pentágono —y eso era solo el contrato inicial, antes de acceder a sistemas clasificados.

Altman mismo admitió que el anuncio “se vio oportunista y descuidado” y que “no debieron apresurarse a sacarlo un viernes”. Pero lo hicieron. Y ahora están adentro.

El nuevo orden de la IA

Estamos viendo en tiempo real cómo las compañías más poderosas de IA eligen su bando:

- OpenAI: Adentro del Pentágono. Sin restricciones sobre uso militar.

- xAI (Musk): “Haremos lo que quieran.”

- Anthropic: Puesta en lista negra por pedir garantías éticas.

- Google DeepMind: Jugando ambos lados, con contratos militares y discurso de seguridad.

Los fundadores de OpenAI alguna vez prometieron desarrollar IA “para el beneficio de la humanidad”. Ahora le dicen a sus empleados que no pueden opinar sobre si ChatGPT se usa para bombardear países.

Bienvenidos a la era de la IA militarizada.

Fuentes: CNBC, Reuters, Seeking Alpha. Marzo 2026.