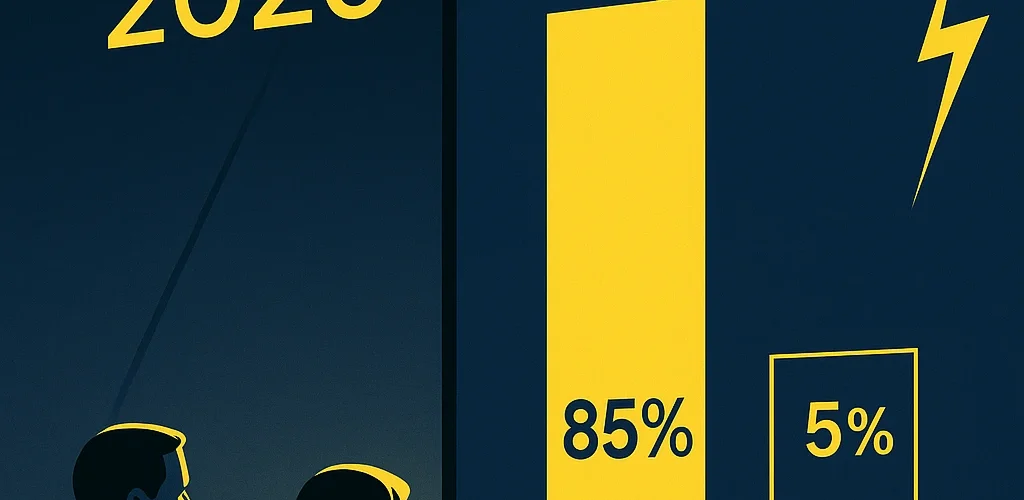

85% de las organizaciones ya están adoptando agentes de IA. Solo el 5% los ha escalado a producción.

Esta semana en RSA Conference 2026 — la conferencia de ciberseguridad más importante del mundo — los expertos dejaron caer un dato que debería preocuparte: 83% de los líderes de seguridad admiten que sus equipos de negocio están desplegando agentes más rápido de lo que pueden evaluarlos.

Traducción: estamos dándole las llaves del carro a robots que no sabemos controlar.

El problema que nadie quiere ver

Matt Caulfield, VP de Producto en Cisco, lo puso en términos claros: los agentes de IA no son ni humanos ni máquinas tradicionales. Son “lo peor de ambos mundos — tienen acceso amplio como los humanos, pero operan a velocidad de máquina, sin juicio y sin responsabilidad institucional.”

Kevin Kennedy, también de Cisco, explicó el vacío: nuestros controles de seguridad actuales solo vigilan quién entra por la puerta principal. No tienen forma de supervisar qué hacen los agentes una vez adentro.

El resultado: shadow AI por todos lados. Empleados usando herramientas que la empresa no aprobó. Agentes abandonados con credenciales activas. Nadie sabe cuántos hay ni qué están haciendo.

Mi take

Esto me recuerda a algo que vivo todos los días operando agentes con OpenClaw.

La velocidad de adopción siempre gana a la velocidad de gobernanza. Es un patrón que se repite: primero el hype, luego la adopción masiva, luego el “oh no, ¿qué hicimos?”

Lo que me llamó la atención del reporte de RSA es la metáfora de HR que propusieron varios expertos: los agentes de IA deben tratarse como empleados, no como software.

- Onboarding: verificar de dónde viene el modelo, con qué datos fue entrenado

- Monitoreo: si un empleado entra a las 4am con un disco duro externo, haces preguntas. ¿Por qué no hacer lo mismo con los agentes?

- Offboarding: agentes que dejaron de ser útiles y siguen en la red con credenciales activas son como ex-empleados con acceso al edificio

La diferencia: no puedes despedir a un agente por mal comportamiento. No tiene miedo a las consecuencias. Solo ejecuta.

Qué deberías hacer

Si en tu empresa o proyecto están usando agentes de IA (o planean hacerlo), pregúntate:

- ¿Tienes inventario? ¿Sabes exactamente cuántos agentes operan en tu entorno?

- ¿Cada agente tiene dueño humano? Alguien responsable de su comportamiento

- ¿Están definidos los límites? ¿Qué puede hacer y qué no puede hacer cada agente?

- ¿Tienes proceso de offboarding? ¿Qué pasa cuando un agente ya no sirve?

Si no puedes responder con seguridad, estás en el 95% que adopta sin escalar. Y eso es una bomba de tiempo.

La gobernanza de agentes no es opcional. Es el precio de entrada para escalar IA de forma responsable.