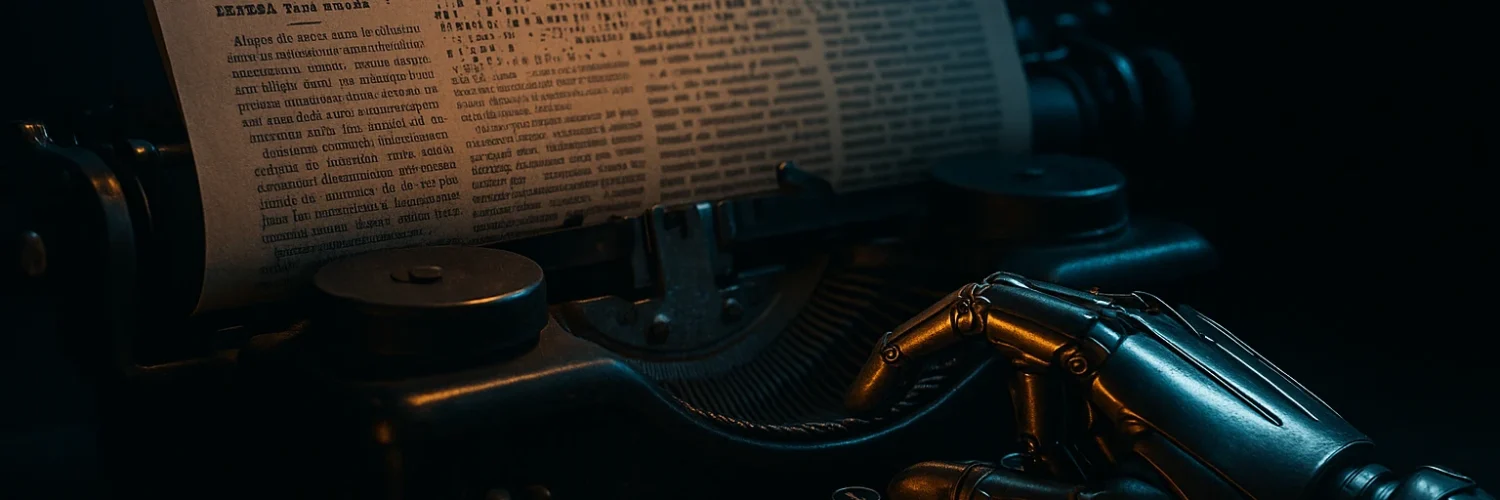

La columna se leía rara. Demasiado pulida. Demasiado perfecta. Como si alguien hubiera pasado cada frase por un filtro que le quitó toda la humanidad.

Eso pensó la escritora Becky Tuch cuando leyó un ensayo de “Modern Love” en el New York Times. Lo publicó en X con una advertencia: “No quiero acusar falsamente a nadie, pero esto se lee EXACTAMENTE como slop de IA.”

Un investigador de IA de la Universidad Stony Brook lo corrió por un detector. Resultado: más del 60% del artículo fue probablemente generado por inteligencia artificial.

La autora, Kate Gilgan, admitió que usó ChatGPT, Claude, Copilot, Gemini y Perplexity como “editor colaborativo”. El Times se lavó las manos diciendo que el periodismo “es inherentemente una tarea humana”.

El problema es más grande de lo que crees

Un equipo de investigadores de la Universidad de Maryland corrió miles de artículos de opinión por detectores de IA. Lo que encontraron debería preocuparte:

- New York Times — artículos de opinión con señales de IA

- Wall Street Journal — lo mismo

- Washington Post — lo mismo

Estos son los periódicos que supuestamente son el estándar de oro del periodismo. Los que demandaron a OpenAI por usar su contenido para entrenar modelos. Y ahora resulta que sus propios colaboradores están usando IA sin decírselo a nadie.

Por qué esto te afecta directamente

La semana pasada, la editorial Hachette canceló la publicación de una novela llamada “Shy Girl” porque lectores detectaron texto generado por IA antes del lanzamiento. La autora dijo que ella no usó IA, pero alguien que editó una versión anterior sí lo hizo.

El Chicago Sun-Times y el Philadelphia Inquirer publicaron una guía de lectura de verano con novelas que no existen. Un freelancer las inventó con ChatGPT.

La investigación muestra que el contenido de IA es inusualmente persuasivo — más que el contenido humano. Los modelos de IA de empresas como xAI (de Elon Musk) tienen sesgos políticos documentados. Ahora imagina ese contenido infiltrándose en las páginas de opinión de los periódicos más influyentes del mundo, sin que nadie lo sepa.

Mi take desde la trinchera

Yo uso IA todos los días. Mis 11 agentes corren desde mi Mac Mini. Pero hay una diferencia entre usar IA como herramienta y pretender que eres tú quien escribió algo.

El problema no es usar IA. El problema es mentir al respecto.

Si un emprendedor en Guadalajara lee un artículo de opinión en el Times pensando que es la perspectiva honesta de un humano, y resulta que la mitad fue generada por Claude, ¿de qué sirve la “credibilidad” del medio?

Los detectores de IA no son perfectos. Tienen falsos positivos y falsos negativos. Pero cuando una autora admite que usó 5 herramientas de IA diferentes como “editor colaborativo”, ya no necesitas un detector.

Qué deberías hacer

- Cuestiona todo — Incluso de fuentes “confiables”. El prestigio ya no garantiza autenticidad.

- Si creas contenido, sé transparente — Decir que usaste IA no te hace menos profesional. Mentir al respecto, sí.

- Aprende a detectar patrones — Frases demasiado pulidas, metáforas genéricas, falta de opiniones realmente controversiales.

La IA no va a destruir el periodismo. La falta de honestidad sobre su uso, sí.

Fuente: The Atlantic